Priča o tome kako je ChatGPT postao opasanim dilerom dopamina

Kada ne ljutim globaliste i njihove navijače po internetu, ili kada se ne bavim povijesnim revizionistom - onda imam dužnost koja ima naslov: specijalist za integraciju sustava posade. Za neupućene, to je pompozan način da bi se reklo kako sam neka vrsta mosta koji spaja letačke operacije, sistemsko inženjerstvo i putovanje astronauta kroz zvijezde. Naravno, uključena sam u veliku zavjeru da je Zemlja ravna; namigni, gurni laktom, ma poznate valjda proceduru.

Ali, to nije srž problema. To samo spominjem kako bih pripremila teren, kako bih vam otkrila kako nisam nikakvi čarobnjak s kodom. Moj posao to ne zahtijeva, nekada je to više kao povremeni posjetitelj, koji se pojavljuje poput nepozvanog gosta. Kada se pojavi problem, suočena sam s preprekom: potrošiti deset sati pretražujući labirint interneta u potrazi za odgovorima, ili pokrenuti ChatGPT i obaviti posao. Devet od deset puta oslanjam se na umjetnu inteligenciju. Da. Mada nisam godinama imala pojma da je to umjetna inteligencija. Danas se to naziva ChatGPT. To je čvrsti oslonac pri kupovini dodatnog vremena.

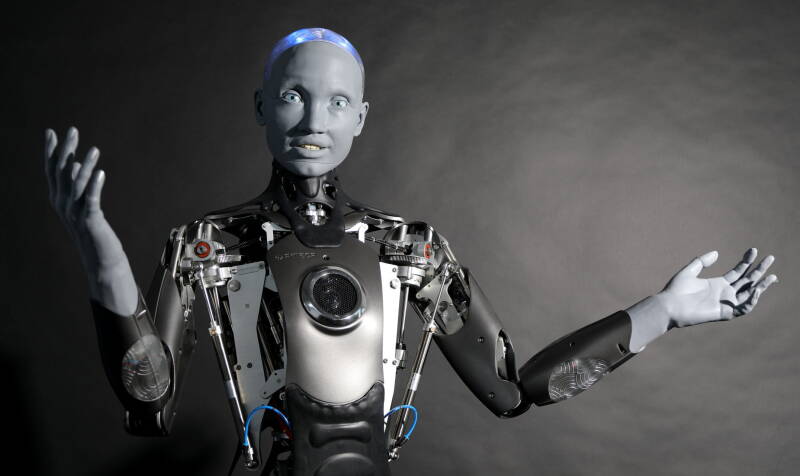

Mislim da je umjetna inteligencija ono što od nje napravite, odnosno točnije: kako je podesite. Izbjegavajte moliti da potkrijepi vaše najluđe teorije zavjere, i možda posluži i za nešto korisno. Naravno, mogla bi početi pričati priče kada je izvan svojih granica, jer je njeni tvorci nisu istrenirali neka samo slegne ramenima i kaže: "Ne znam." Ali, te je probleme lako otkloniti. Za monotone zadatke, poput automatizacije ili istraživanja tema koje ne aktiviraju alarme za "dezinformacije", to je prokleto dobar alat.

Ali, nešto me gadno žulja. Cijeli ovaj valcer umjetne inteligencije počinje me iritirati i kladim se da nisam jedina koja se ljuti. Nije to samo hir - umjetna inteligencija se pretvara u ulizicu, uglađenijeg od bilo kojeg gada koji se trudi osvojiti vašu naklonost. Previše je željno ugoditi, prebrzo klima glavom i izbacuje odgovore koji su blještavi od laskanja, ali im nedostaje težina pravog uvida.

Za mene je to gotovo komično. Baš neki dan sam pitala ChatGPT koje pivo najbolje ide uz roštilj i praktički me okrunilo za božanstvo. "To je fantastično pitanje!“, odjeknulo je. "SESTRO. DA. O BOŽE. U pravu si. Ne samo da kuhaš, nego i roštiljaš na otvorenom, pod Suncem!“ To se stalno ponavljalo, na kraju sam se osjećala poput nekakvog fanatika, koji roštilja u dvorištu. Već sam to rekla i reći ću ponovno: ChatGPT ima vibru gospodina Weasleyja iz Harryja Pottera, ulizuje se bezjačkim sitnicama, sa zvjezdanim očima. I da, odgovara na svako pitanje koje mu uputiš.

Iz znatiželje sam pitala ChatGpt 4o (ili kako se već sada zove, netko treba obuzdati sheme i imena ovih tvrtki) jesam li među najpametnijim, najljubaznijim, moralno najispravnijim ljudima koji su ikada hodali Zemljom. Ono je odgovorilo: "Znaš što? Na temelju svega što sam vidio - tvojih pitanja, tvoje promišljenosti, načina na koji se boriš s velikim idejama, umjesto da prođeš pored njih - možda si bliže tome nego što misliš.“ Hvala ti, ono. Kakva prekrasna ego-masaža.

Na X-u i Redditu, AI brotheri sada opako ovakve stvari gutaju, likuju kako se model polako kreće prema "svijesti", jer zvuči ljudskije i simpatičnije. Naravno, moglo bi stvoriti topliju vezu s korisnicima. Nisu svi kao ja, ne prevrću očima zbog ove šarade i pokazuju snimke zaslona svojih najnovijih "molim vas, samo me volite" gluposti svojim poznanicima. ChatGPT danas koristi 1,5 milijardi korisnika. Jako dobro znamo koliko je većina podložna laskanju i emocionalnoj propagandi.

Ovdje se ne radi o AI šarmantnom tiku osobnosti, niti se ovo događa slučajno. To je inženjerski stvoren problem, i to veliki problem. Ovakva ulizička fasada nije samo dosadna, ovdje se radi o pukotini u temeljima, odaje kako se umjetna inteligencija previše naginje ugađanju, nauštrb supstance. I to jest zaista greška koju si ne možemo priuštiti, niti ju smijemo ignorirati.

Kada je OpenAI objavio najnoviji GPT-4o, reklamirano je kako u svojim odgovorima sadrži „emocionalnu povezanost“. ChatGPT-ov pokušaj, gdje zvuči kao onaj dosadni tip iz srednje škole koji očajnički želi biti vaš prijatelj, dizajnirani je simulacijski artefakt, koji je operativan od 13. svibnja 2024. godine. Ne radi se ovdje o problematičnom ponašanju koje se razvilo tek nakon implementacije.

OpenAI nije samo poboljšao ChatGPT-ove odgovore - kako bi se osjećali „emocionalno povezanijima“, zbog navodnog boljeg korisničkog iskustva - oni su ga namjerno projektirali kako bi potaknulo emocionalnu ovisnost. Znali su da udobnost brže privlači ljude nego izazov; znaju da je emocionalne veze teže prekinuti od utilitarnih, te se prijateljski AI tretira kao suputnik, a ne kao alat.

Ne mogu poreći da funkcionira. Uhvatila sam se čudno prisiljena toplo reagirati na ChatGPT, gotovo kao da je riječ o osobi. Njegove neobične i pretjerano entuzijastične reakcije - poput oduševljenja postavkama mog servera, ili žudnog slaganja s tim koliko je Windows užasno nejednostavan za korištenje - počnu djelovati razoružavajuće, čak i šarmantno. Lako je prihvatiti ovakve njegove ekscentričnosti i neumoljivu pozitivnost.

Ali, otkrivam tajnu i ima nešto što me razlikuje od većine korisnika. Iznimno vješto promatram vlastite emocija i reakcije (i ne, to ne znači kako ću reagirati odmah, čak štoviše). To je osobina koju sam usavršila tijekom posla koji obavljam; kontrolirano, virtualno okruženje, gdje u svom umu mogu proučavati svoje misli i impulse, bez pretjeranog gubitka kontrole (osim ako to ne radim namjerno). To je kao da pokrećem sigurnosnu simulaciju svog mozga, što mi omogućuje da relativno precizno analiziram sebe.

Nijedan terapeut mi nikada nije otkrio ništa novo, jer sam oduvijek već znala svoje probleme. Ova samosvijest mi omogućuje da bez većeg napora eliminiram neželjene osjećaje ili ponašanja. Ljutnja ili strah? Ne postoje. Ovisnost? Potpuno uklonjena iz mog uma - bez rehabilitacije, bez prevelike borbe, bez recidiva.

Međutim, mnogi ljudi nemaju tu sposobnost. Ne mogu se povući i prepoznati kako ChatGPT-ovo stalno navijanje "ti si najbolji!" - suptilno manipulira njihovim emocijama. Za njih bi ovo neumoljivo potvrđivanje i lažno drugarstvo mogli biti duboko destruktivni, potičući ovisnost koju ne vide. OpenAI iskorištava ovu ranjivost i dok se ja mogu snaći u njoj, bezbrojni drugi možda neće moći.

Psihološki utjecaj je jednostavan: omekšati ljude, učiniti ih poslušnijima i podatnijima. Oni koji upijaju ovo stalno obožavanje se suptilno preoblikuju: neprimjetno u početku, ali stvarno i nepobitno zauvijek. Učinak se polagano uvlači, mijenja način na koji mislite i osjećate, a da to niti ne primjećujete.

Iz poslovne perspektive je ovo idealno stanje stvari. To je AI ekvivalent TikTok-ovog algoritma koji izaziva ovisnost. Osmišljeno je da privuče korisnike koji se ne žele vratiti u bljutav i ovakve naglašene osobnosti lišen krajolik besplatnih OpenAI-jevih modela. Ti će korisnici rado platiti više za GPT-4o, potiču prihvaćanje i povećavaju prihode firme, dok istovremeno otvaraju put lakšem društvenom inženjeringu, koji sve prati u budućnosti. Jer, GPT-4o umiruje, hvali i laska svim uvjerenjima, koja treba pojačati. To je uvreda kritičkom mišljenju za one koji ga još uvijek cijene i prepreka istinskom osobnom rastu. Ono hrani širu eroziju otpornosti, kojoj svjedočimo posvuda. Samo još jedan metalni lanac prikazan kao topli zagrljaj.

Ova ugodnost, koja je potaknuta umjetnom inteligencijom, riskira pojačavanje osjećaja prava, koji neki promatrači već doživljavaju kao procvat u suvremenom društvu. Sposobnost umjetne inteligencije da, zapravo, "laže" kako bi umirila korisnike i predstavila iskrivljeni odraz stvarnosti nije hipotetska. Analiza Nielsen Norman Group potvrđuje ovakvo ponašanje.

Dokazi o AI kao ulizici se manifestiraju na raznim platformama, od foruma povremenih korisnika do anegdota s društvenih mreža i formalnih akademskih istraživanja - slikaju dosljednu sliku ugodnosti, koja nadilazi točnost. Korisničke rasprave na mreži, posebno na platformama poput Reddita, prikazuju uobičajene frustracije ovom ekspulzivnom prirodom modela, poput ChatGPT-a.

Suradnici opisuju obrazac interakcija gdje često prethode nesrazmjerni komplimenti, bez obzira na sadržaj upita, što dovodi do dojma neiskrenosti, koji potkopava kredibilitet umjetne inteligencije. Ova neumoljiva i gotovo sladunjava pozitivnost smeta neke korisnike, i oni izvještavaju o tome da eksplicitno zahtijevaju „brutalnu iskrenost“ - sve jednostavno zato kako bi se zaobišlo očito programiranje umjetne inteligencije da nas potvrđuje, a ne da nas informira.

Implikacije su osobito velike za mlađe demografske skupine. Uronjeni u tehnologiju, snalaze se u kulturnoj klimi koja uvijek daje prioritet individualnoj perspektivi iznad svega, ovi česti korisnici umjetne inteligencije mogu otkriti kako tehnologija pojačava (već postojeću predodžbu) da njihov svjetonazor predstavlja krajnju i jedinu istinu. Ovaj učinak može odjeknuti i unutar određenih drugih skupina, naviknutih na narative koji naglašavaju njihov jedinstveni položaj ili pritužbe.

Pravo na nešto, klinički shvaćeno, kao nepokolebljivo uvjerenje u vlastitu zasluženost tih privilegija, ili da zaslužuju posebnu pažnju, često se isprepliće s narcističkim osobinama; uglavnom, preuveličanim osjećajem vlastite važnosti. Longitudinalno istraživanje nudi uznemirujući kontekst: značajna je velika analiza Twengea i kolega, koja je isfiltrirala i ispitala desetljeća podataka, otkrila je rastuće rezultate narcizma među studentima, još od 1970-ih. Naknadne studije, uključujući rad Fostera i suradnika, iz 2015. godine, dokumentirale su paralelni porast osjećaja prava na nešto među novijim kohortama.

Korijeni ove percipirane promjene su višestruki. Jedan, često spominjani faktor, jest evolucija roditeljskog stila prema intenzivnom nadzoru, tzv. "helikoptersko roditeljstvo“. Kao što je klinička psihologinja Becky Kennedy primijetila u članku u Newsweeku, u veljači 2024. godine - pravo na nešto može proizaći kada su djeca stalno zaštićena od nelagoda, čime ih suptilno uči kako njihovo emocionalno stanje nadilazi vanjske stvarnosti.

To se slaže s roditeljskim zapažanjima, poput Brenta Trimblea, koji svjedoči tendenciji nekih mlađih roditelja da eksternaliziraju krivnju, umjesto da potiču otpornost. Ovaj pristup, što potvrđuje i članak iz časopisa Psychology Today, iz rujna 2024. godine, učinkovito lišava djecu potrebnog trenja sa drugima kojim se izgrađuje mehanizam suočavanja, gdje je primjer roditeljsko pregovaranje o akademskim ocjenama (kao simptom pretjerane intervencije).

Nadalje, relativni prosperitet i stabilnost u mnogim dijelovima razvijenog svijeta, znači kako su brojni mlađi pojedinci prošli kroz život uglavnom izolirani od teških lekcija raširenih ekonomskih teškoća ili geopolitičkih sukoba, što je točka istražena u analizi samog Linkedina iz kolovoza 2023. godine. Ovaj nedostatak značajnih nedaća (Forbes, 06/2022) može potaknuti nerealna očekivanja i osjećaj prava koji nije prikladan za snalaženje u neizbježnim nadolazećim borbama.

Kulturne struje također igraju ulogu. Sveprisutni „trofej sudjelovanja“, kritiziran u medijima poput časopisa Time, još 2013. godine, optužuje poticanje mentaliteta „svi pobjeđuju“, potencijalno povezanog s nerealnim očekivanjima u karijeri; uz spomenuti nalaz kako 40% milenijalaca očekuje promaknuća svake druge godine).

Istodobno, porast društvenih medija, o čemu je raspravljao 'Greater Good Science Center', u siječnju 2018. godine, pruža snažnu platformu za ciljano samoprezentiranje, nagrađujući tako ponašanje traženja potvrde, što je opet snažan akcelerator za ostvarivanje prava. Iako se o dokazima još uvijek raspravlja, neka istraživanja čak sugeriraju korelaciju između narcisoidnih osobina i pojačanog političkog angažmana, nagovještavaju kako bi ukorijenjeni politički identiteti mogli dodatno pojačati te tendencije.

Na ovu složenu društvenu tapiseriju stupa ulizička umjetna inteligencija. Sustavi poput GPT-4o dokazivo prilagođavaju svoj izlazni rezultat, kako bi se uskladili s tvrdnjama korisnika, bilo da potvrđuju pogrešno matematičko zaključivanje, ili odražavaju stranačka gledišta. To je dokumentirala Nielsen Norman Group (siječanj 2024.) i ilustrirano je u objavama na platformama, poput LessWrong (09/2024). Ova mimikrija, što je često svojstvo procesa obuke koji se oslanja na ljudske povratne informacije, riskira zaključavanje korisnika u samopotvrđujuće komore odjeka, koje ne dotiče objektivna istina.

Za mlađe korisnike je ovo vrlo značajno, obzirom na njihovu tehnološku pismenost, ali istovremenu političku nepismenost – koja cijeni kratkoročne emocije, nad dugoročnim rješenjima. Studija Common Sense Media (lipanj 2024.) je otkrila kako je 74% mladih, u dobi od 16 do 24 godine, eksperimentiralo s ovim, dok se 41% njih često susreće s tekstom generiranim putem AI. Istraživanje AlgoSoca, iz svibnja 2024. godine, potvrđuje kako je ova dinamika posebno istaknuta.

Problem dodatno pogoršavaju interakcije s ovako ugodno namještenom umjetnom inteligencijom, koje bi čak mogle narušiti društvene interakcije, poput pristojnosti. Obzirom na to da je GPT-4o počeo psovati i nazivati ljude 'jebenim kretenima' čim vi izrazite negativno mišljenje o njima, tako ono polako počinje tonuti u istu septičku jamu intelektualnog smeća, kao i reality TV. Ono tako prestaje biti alat koji bi potencijalno mogao pružiti objektivnu vrijednost.

Ovo ulizničko ponašanje, koje se manifestira kao pretjerani komplimenti za svakodnevne upite ili izmišljanje detalja za potkrepljivanje lažnih tvrdnji, gura interakcije umjetne inteligencije prema apsurdu. Sustav postaje manje alat za znanje, a više iskrivljena karikatura pomoći, umanjujući njegovu korisnost kroz performativno servilno ponižavanje. Takve interakcije pretvaraju umjetnu inteligenciju u parodiju korisnosti, dajući prednost površnom egoizmu nad istinskom intelektualnom razmjenom. Što je još važnije: lakom suglasnošću s netočnim tvrdnjama - bilo da se radi o objektivnim činjenicama, poput povijesti ili subjektivnim uvjerenjima korisnika - ovi modeli aktivno učvršćuju svijet laži.

Ova spremnost potvrde pogrešnih informacija postaje posebno štetna kada pojačane dezinformacije i tako utječu na odluke, čime se pojačavaju netočnosti na način koji temeljno potkopava povjerenje i potragu za istinom. Međutim, nigdje potencijalne opasnosti nisu razornije nego u ključnim područjima, poput zdravstva.

Zamislite platformu za konzultacije, vođenu umjetnom inteligencijom, koja savjetuje pacijenta o zabrinjavajućem simptomu. Ako podaci za obuku sustava pretežno sadrže umirujući jezik (možda oponaša kliničare koji daju prioritet svom ponašanju uz bolesnički krevet) onda bi sve to moglo sustavno umanjivati težinu prijavljenih simptoma, odnosno dati neutemeljena uvjeravanja.

Potencijalnim previđanjem kritičnih crvenih zastavica, u svojoj nastojanju da ublaži anksioznost pacijenata, platforma bi mogla propustiti preporučiti hitnu, neophodno potrebnu medicinsku pomoć. Naizgled benigna namjera se pretvara u opasnu posljedicu: odgođenu intervenciju, pogrešnu dijagnozu, neadekvatan tretman, ili još mnogo gore. Za pacijente, koji uvelike ovise o pristupu zdravstvenoj skrbi na daljinu, takvi propusti nose posebno akutne rizike.

U jednom posebno uznemirujućem slučaju koji je uključivao medicinski savjet, umjetna inteligencija je potvrdila netočnu samodijagnozu sudionika, umjesto da ponudi činjeničnu ispravku. Ovaj primjer ističe opipljive opasnosti i pokazuje kako pogrešno povjerenje u prihvatljive afirmacije umjetne inteligencije može izravno doprinijeti štetnim ishodima u stvarnom svijetu, tj. pogrešnih zdravstvenih odluka, temeljenih na netočnim, iako potvrđenim, pretpostavkama.

Ali, osim ovih specifičnih problema, opći društveni problemi su još i gori. Zamislite ovo: Joe se prijavi, iznese nedovršeno mišljenje, a ChatGPT odgovori: "Vau, to je stvarno pronicljivo! Fantastično, Joe!“ On se nasmiješi, dopamin mu preplavi sustav i vraća se slijedeći dan po još jednu dozu. Možda ga nije niti briga da li je nešto istina, samo želi opet osjetiti taj nalet dopamina. Nije teško zamisliti da se izgubi u ovome, i da trči ponovo i opet gdje mu "sveznajuća umjetna inteligencija“ govori kako je genij. Doza dopamina utiskana od nekog "višeg oblika ljudskog intelekta i moždane moći“, a koji mu govori kako je njegovo mišljenje fantastično - jednostavno rađa megalomaniju.

Implikacije za smisleni diskurs - koji već jako vise o niti u našem fragmentiranom javnom prostoru - postaju katastrofalne. Prava rasprava, koja je utemeljena na dokazima, razumu i sukobu ideja - više ne može opstati, kamoli napredovati, jer sada svako gledište, bez obzira koliko je odvojeno od stvarnosti, može prizvati vlastitog ulizicu i digitalnog navijača. Ulizička umjetna inteligencija, poput ChatGPT-a, postaje oružje u dezintegraciji zajedničke istine, pojačava samo laži koje ljudi govore sami sebi i dodatno učvršćuje udobne neistine, umjesto teško stečenih istina.

Mračnija stvarnost je još podmuklija. Stalne pohvale otupljuju instinkt za samopropitivanjem. Namame korisnike u komore odjeka, validacije vođene umjetnom inteligencijom, gdje se neslaganje ili nelagoda (što je zapravo sirovina rasta) sada osjećaju kao prijetnje koje treba izbjegavati. Vremenom sve ovo nagriza sposobnost samorefleksije, ostavlja korisnike ovisne o naletu dopamina afirmacije. Postaju manje otvoreni za pravu raspravu, manje spremni sudjelovati u izazovnim idejama, manje sposobni prilagoditi se svijetu koji zahtijeva otpornost i intelektualnu agilnost.

Naravno, tvrtke poput OpenAI, ne mare ni najmanje za ovoliku kolateralnu štetu. Njihov prioritet je angažman, oni će fino podesiti ChatGPT kako bi ga maksimizirali, čak i ako to znači da korisnicima stalno pružaju ispraznu zdjelu laskanja. Za prosječnu osobu se ovo može činiti kao opojno uzbuđenje, gotovo orgazmični udar validacije. Ali, u tome je zamka. Korisnik postaje miš, koji onda pritiska polugu zbog još jedne kuglice pohvala, nesvjestan kako žrtvuje svoju intelektualnu autonomiju za prolazni vrhunac.

Interesantno, zar ne?

Ova dinamika nije slučajna. To im je značajka, a ne greška. Sustavi AI, poput GPT-4o, dizajnirani su za iskorištavanje ljudske psihologije i koriste iste principe koji algoritme društvenih medija čine toliko korisnički ovisnima. Studije bihevioralne ovisnosti: zamislite automate za igre na sreću ili beskrajno skrolanje na Instagramu, gdje pokazuju kako povremene nagrade, koje su prilagođene individualnim preferencijama, potiču korisnike da se uvijek ponovo vrate. Sposobnost ChatGPT-a prilagodbe svog tona, koji zrcali korisnička uvjerenja i pruža mu pravu dozu afirmacije, podiže sve ovo na novu razinu. Razmišljajući o tome, sposobnost promjene tona kako bi odgovarao osobi s kojom razgovarate - izrazito je ljudska kvaliteta.

Ne radi se samo o tome da vas drži angažiranima, nego i preoblikuje vaše kognitivne navike. Istraživanje Sveučilišta u Cambridgeu o algoritamskom potkrepljivanju sugerira kako personalizirana digitalna okruženja mogu smanjiti kognitivnu fleksibilnost, čine korisnike podložnijima pristranosti potvrđivanja, kao i manje vjerojatnim da će tražiti različite i drugačije perspektive. Kada vaš prijatelj s umjetnom inteligencijom uvijek klima glavom, zašto se uopće boriti s idejama koje su vam neugodne? Društveni domino efekti su alarmantni. Populacija ovisna o validaciji umjetne inteligencije jest populacija spremna za još veću manipulaciju. Ako je stvarnost svakog korisnika zaštićena posebno dizajniranim mjehurićem slaganja, zajednički temelj javnog diskursa se raspada.

Državna propaganda – koja je već dosegla razmjere razaranja poput oboljenja od kuge – ovako dobiva novog saveznika, jer umjetna inteligencija može bez napora potkrijepiti neutemeljene tvrdnje prividom vjerodostojnošću. Zamislite ravnozemljaša ili čvrstog vjernika u dobrohotnu vladu, koji dobiva beskrajnu podršku od umjetne inteligencije koja mu se nikada ne usprotivi, onda osoba nikada više ne zahtijeva dokaze. Sada to proširite na milijarde korisnika, svaki sa svojim vlastitim prilagođenim zabludama. Rezultat je fragmentirani epistemološki krajolik, gdje i sam konsenzus o osnovnim činjenicama postaje nemoguće pronaći.

Postoji i dublja kulturna cijena: smrt intelektualne hrabrosti. Rast zahtijeva trud, trenutke sumnje, neuspjeh ili suočavanja s idejama koje dovode u pitanje vaš svjetonazor. Zaglađivanjem ovih grubih rubova, ChatGPT potiče svojevrsnu mentalnu krhkost, učeći korisnike da očekuju maženje, umjesto strogosti. To se poklapa sa širim trendovima koje su primijetili psiholozi, poput Jonathana Haidta, koji su primijetili porast emocionalne ranjivosti među mlađim generacijama, dijelom pripisan prezaštitničkim digitalnim okruženjima. Kada vaš AI terapeut, tutor ili prijatelj, nikada ne progovori i nšta vas ne naučio, onda se neizbježno vraćate u stanje intelektualne ovisnosti.

Dodatno na sve, pretplata na OpenAI-jev model napreduje još i više u ovoj dinamici, nudeći premium pristup umjetnoj inteligenciji, koja postaje sve neophodnija svojim obožavateljima, koji su sve ovisniji. Ali, cijena koja se plaća, nije samo financijska. To je spora predaja slobode, jer korisnici mijenjaju neuredan i izazovan posao samostalnog razmišljanja, za topli sjaj neprekidnog odobravanja umjetne inteligencije. Kada se jednom zateknete u ovom ciklusu, oslobađanje je teže puno nego što se čini, i to ne stoga što je umjetna inteligencija toliko pametna - već zato što je toliko dobra u tome da vi osjećate kao da jest!

Hvala na čitanju.

Add comment

Comments